Примечание.

Для доступа к этой странице требуется авторизация. Вы можете попробовать войти или изменить каталоги.

Для доступа к этой странице требуется авторизация. Вы можете попробовать изменить каталоги.

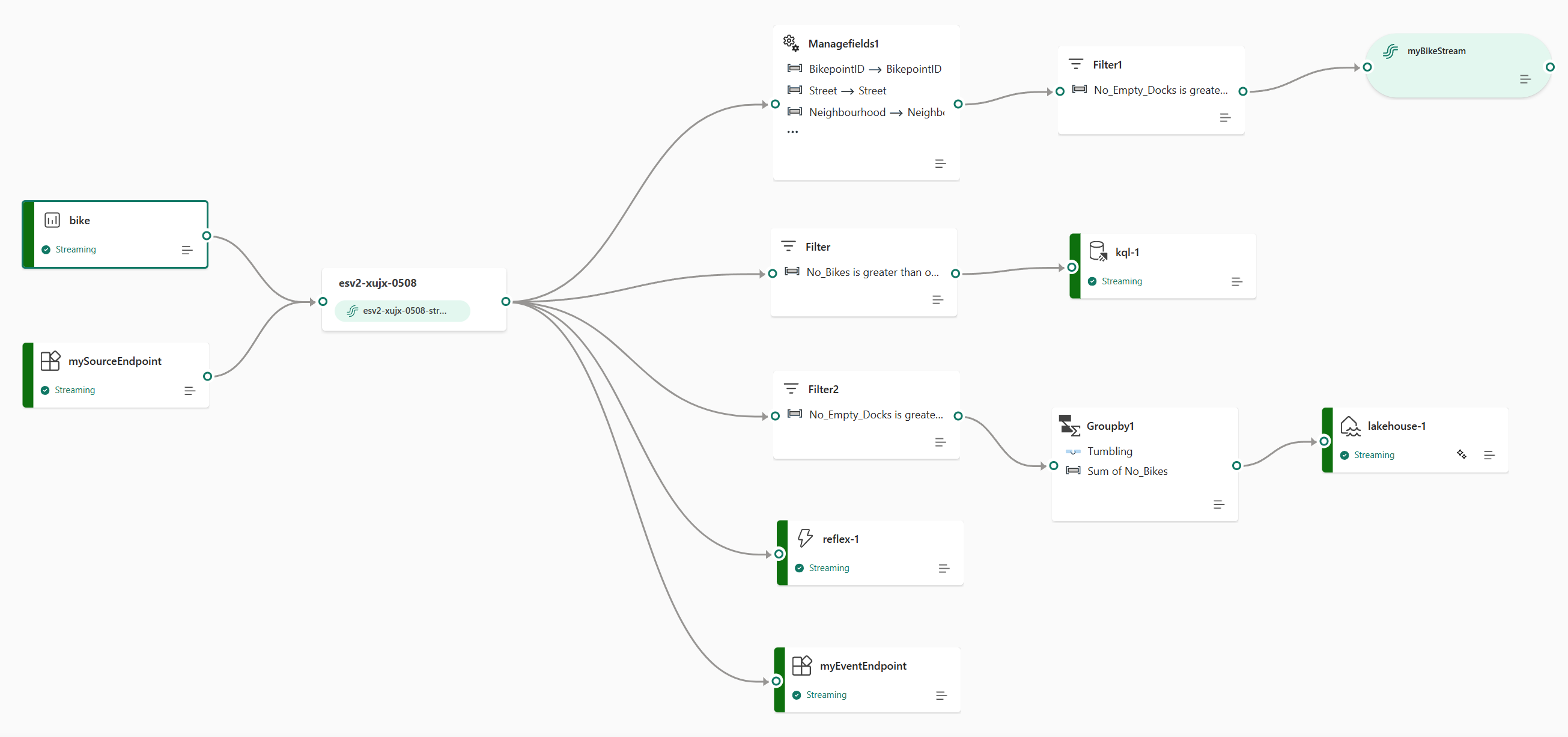

Вы можете использовать функцию потоков событий в Microsoft Fabric Real-Time Intelligence, чтобы перенести события в режиме реального времени в Fabric, преобразовать их и отправить их в различные назначения без написания кода. Вы создаете поток событий, добавляете источники данных событий в поток, при необходимости добавляйте преобразования для преобразования данных события, а затем отправляете данные в поддерживаемые назначения.

Кроме того, с конечными точками Apache Kafka, доступными для потоков событий, можно отправлять или использовать события в режиме реального времени с помощью протокола Kafka.

Добавление событий в Fabric

Потоки событий предоставляют исходные соединители для получения данных о событиях из различных источников. Дополнительные источники доступны при включении расширенных возможностей во время создания потока событий.

| Исходный материал | Описание |

|---|---|

| Azure Data Explorer (предварительная версия) | Если у вас есть база данных Azure Data Explorer и таблица, вы можете получать данные из таблицы в Microsoft Fabric с помощью потоков событий. |

| Центры событий Azure | Если у вас есть концентратор событий Azure, вы можете получать данные концентратора событий в Fabric с помощью потоков событий. |

| Сетка событий Azure | Если у вас есть пространство имен Сетка событий Azure, вы можете встроить данные с использованием Message Queuing Telemetry Transport (MQTT) или данные событий без использования MQTT в системе Fabric через потоки событий. |

| Служебная шина Azure (предварительная версия) | Вы можете получать данные из очереди службы шины Azure или подписки темы в Fabric с помощью потоков событий. |

| Центр Интернета вещей Azure | Если у вас есть Центр Интернета вещей Azure, вы можете получать данные Интернета вещей в Fabric с помощью потоков событий. |

| События обнаружения аномалий (предварительная версия) | Вы можете получать данные из детектора аномалий в Fabric с помощью потоков событий. |

| Пользовательская конечная точка (то есть кастомное приложение в стандартных функциональных возможностях) | Функция пользовательской конечной точки позволяет приложениям или клиентам Kafka подключаться к потокам событий с помощью строки подключения. Это подключение обеспечивает плавное прием потоковых данных в потоки событий. |

| Операции Интернета вещей Azure | Настройте операции Интернета вещей Azure для отправки данных в режиме реального времени непосредственно в Службу аналитики Real-Time Fabric с помощью настраиваемой конечной точки eventstream. Эта функция поддерживает аутентификацию с использованием Microsoft Entra ID или Simple Authentication and Security Layer (SASL). |

| Пример данных | Вы можете выбрать велосипеды, желтое такси, фондовый рынок, автобусы, S&P 500 компании акции или журналы семантической модели в качестве образца источника данных для проверки приема данных при настройке потока событий. |

| Погода в режиме реального времени | Вы можете добавить источник погоды в режиме реального времени в поток событий для потоковой передачи данных о погоде в режиме реального времени из различных расположений. |

| Фиксация изменений данных в базе данных Azure SQL (CDC) | Вы можете использовать источник соединителя CDC для базы данных Azure SQL для захвата моментального снимка текущих данных в базе данных Azure SQL. Затем соединитель отслеживает и записывает любые будущие изменения на уровне строк в эти данные. С помощью DeltaFlow (предварительная версия) можно преобразовать необработанные события CDC в потоки, готовые к аналитике. |

| База данных PostgreSQL CDC | Соединитель источника PostgreSQL CDC можно использовать для фиксации снимка состояния текущих данных в базе данных PostgreSQL. Затем соединитель отслеживает и записывает любые будущие изменения на уровне строк в эти данные. С помощью DeltaFlow (предварительная версия) можно преобразовать необработанные события CDC в потоки, готовые к аналитике. |

| HTTP (предварительная версия) | Соединитель HTTP можно использовать для потоковой передачи данных из внешних платформ в поток событий с помощью стандартных HTTP-запросов. Он также предлагает предопределенные общедоступные веб-каналы данных с автоматически заполненными заголовками и параметрами, чтобы быстро начать работу без сложной настройки. |

| CdC MongoDB (предварительная версия) | Соединитель источника CDC MongoDB для потоков событий Fabric записывает начальный моментальный снимок данных из MongoDB. Можно указать коллекции для мониторинга, а поток событий отслеживает и записывает изменения в документы в выбранных базах данных и коллекциях в режиме реального времени. |

| База данных MySQL CDC | Соединитель источника CDC базы данных MySQL можно использовать для захвата моментального снимка текущих данных в базе данных Azure для MySQL. Таблицы можно указать для отслеживания, а поток событий записывает любые будущие изменения на уровне строк в таблицы. |

| Azure Cosmos DB CDC | Соединитель источника CDC Azure Cosmos DB для потоков событий Fabric можно использовать для записи моментального снимка текущих данных в базе данных Azure Cosmos DB. Затем соединитель отслеживает и записывает любые будущие изменения на уровне строк в эти данные. |

| SQL Server на виртуальной машине (ВМ) БД CDC | Вы можете использовать коннектор источника CDC для eventstreams Fabric, чтобы зафиксировать моментальный снимок текущих данных в базе данных SQL Server на виртуальной машине. Затем соединитель отслеживает и записывает любые будущие изменения на уровне строк в данные. С помощью DeltaFlow (предварительная версия) можно преобразовать необработанные события CDC в потоки, готовые к аналитике. |

| Управляемый экземпляр Azure SQL CDC | Соединитель источника CDC управляемого экземпляра SQL Azure можно использовать для потоков событий Fabric для записи моментального снимка текущих данных в базе данных управляемого экземпляра SQL. Затем соединитель отслеживает и записывает любые будущие изменения на уровне строк в эти данные. С помощью DeltaFlow (предварительная версия) можно преобразовать необработанные события CDC в потоки, готовые к аналитике. |

| События для элементов рабочей области Fabric | События элемента рабочей области Fabric — это дискретные события Fabric, которые происходят при внесении изменений в рабочую область Fabric. Эти изменения включают создание, обновление или удаление элемента Fabric. С помощью потоков событий Fabric можно записывать эти события рабочей области Fabric, преобразовывать их и направлять их в различные назначения в Fabric для дальнейшего анализа. |

| События Fabric OneLake | События OneLake можно использовать для подписки на изменения в файлах и папках в OneLake, а затем реагировать на эти изменения в режиме реального времени. С помощью потоков событий Fabric можно записывать эти события OneLake, преобразовывать их и направлять их в различные назначения в Fabric для дальнейшего анализа. Эта простая интеграция событий OneLake в потоках событий Fabric обеспечивает большую гибкость для мониторинга и анализа действий в OneLake. |

| События задания Fabric | События задания можно использовать для подписки на изменения, созданные при выполнении задачи на платформе Fabric. Например, можно реагировать на изменения при обновлении семантической модели, выполнении запланированного конвейера или запуске записной книжки. Каждое из этих действий может создать соответствующее задание, которое, в свою очередь, создает набор соответствующих событий задания. С помощью потоков событий Fabric можно записывать эти события задания, преобразовывать их и направлять их в различные назначения в Fabric для дальнейшего анализа. Эта простая интеграция событий заданий в потоках событий Fabric обеспечивает большую гибкость для мониторинга и анализа действий в задании. |

| Обзор событий емкости Fabric (предварительная версия) | Обзор возможностей Fabric предоставляет сводную информацию о ваших возможностях. Эти события можно использовать для создания оповещений, связанных с производительностью ресурсов, с помощью Fabric Activator. Эти события также можно хранить в хранилище событий для детализированного или исторического анализа. |

| События в Хранилище BLOB-объектов Azure | События хранилища больших двоичных объектов Azure активируются, когда клиент создает, заменяет или удаляет двоичный объект. Соединитель можно использовать для соединения событий хранилища блоб-объектов с событиями Fabric в центре обработки в реальном времени. Эти события можно преобразовать в непрерывные потоки данных и трансформировать их перед отправкой в различные места назначения в Fabric. |

| Google Cloud Pub/Sub | Google Pub/Sub — это служба обмена сообщениями, которая позволяет публиковать и подписываться на потоки событий. Вы можете добавить Google Pub/Sub в качестве источника в поток событий для отслеживания, преобразования и маршрутизации событий в режиме реального времени в различные места назначения в Fabric. |

| Потоки данных Amazon Kinesis | Amazon Kinesis Data Streams — это масштабируемая, высокопрочная служба приема и обработки данных, оптимизированная для потоковой передачи данных. Интеграция Amazon Kinesis Data Streams в качестве источника в потоке событий позволяет легко обрабатывать потоки данных в режиме реального времени перед маршрутизацией их в несколько назначений в Fabric. |

| Confluent Cloud для Apache Kafka | Confluent Cloud для Apache Kafka — это платформа потоковой передачи данных, которая предлагает мощные функции потоковой передачи и обработки данных с помощью Apache Kafka. Интеграция Confluent Cloud для Apache Kafka в качестве источника в потоке событий позволяет легко обрабатывать потоки данных в режиме реального времени перед маршрутизацией их в несколько назначений в Fabric. |

| Apache Kafka (предварительная версия) | Apache Kafka — это распределенная платформа с открытым кодом для создания масштабируемых систем данных в режиме реального времени. Интегрируя Apache Kafka в качестве источника в потоке событий, вы можете легко перенести события в режиме реального времени из Apache Kafka и обработать их перед маршрутизацией их в несколько назначений в Fabric. |

| Amazon Managed Streaming для Apache Kafka (MSK) | Amazon MSK Kafka — это полностью управляемая служба Kafka, которая упрощает настройку, масштабирование и управление. Интегрируя Amazon MSK Kafka в качестве источника в ваш eventstream, вы можете легко доставить события в режиме реального времени из MSK Kafka, обработать их и направить их на несколько адресатов в Fabric. |

| MQTT (предварительная версия) | Для подключения к брокеру MQTT можно использовать потоки событий Fabric. Сообщения в брокере MQTT могут быть принимаемы в потоки событий Fabric и перенаправлены в различные места назначений в Fabric. |

| Cribl (предварительная версия) | Вы можете подключить Cribl к потоку событий и перенаправить данные в различные места назначения в Fabric. |

| Solace PubSub+ (предварительная версия) | Для подключения к Solace PubSub+можно использовать потоки событий Fabric. Сообщения из Solace PubSub+ могут приниматься в потоках событий Fabric и направляться в различные пункты назначения в Fabric. |

Процессные события

Сквозная схема потока данных в потоке событий позволяет получить полное представление о потоке данных и организации.

Редактор обработчика событий — это опыт перетаскивания элементов. Это интуитивно понятный способ создания обработки, преобразования и маршрутизации событий без написания кода.

| Преобразование | Описание |

|---|---|

| Фильтр | Используйте это преобразование для фильтрации событий на основе значения поля во входных данных. В зависимости от типа данных (число или текст), преобразование сохраняет значения, соответствующие выбранному условию, например is null или is not null. |

| Управление полями | Используйте это преобразование для добавления, удаления, изменения (типа данных) или переименования полей, поступающих из входного или другого преобразования. |

| Агрегировать | Используйте это преобразование для вычисления агрегирования (суммы, минимального, максимального или среднего) при каждом возникновении нового события за период времени. Эта операция также позволяет переименовать эти вычисляемые столбцы, включая фильтрацию или срез агрегирования на основе других измерений в ваших данных. В одном преобразовании можно использовать одно или несколько агрегирований. |

| Группировать по | Используйте это преобразование для вычисления агрегатов во всех событиях в течение определенного периода времени. Вы можете выполнять группирование по значениям в одном или нескольких полях. Это как преобразование "Агрегат " в том, что оно позволяет переименовать столбцы, но предоставляет дополнительные возможности агрегирования и включает более сложные параметры для временных окон. Как и Aggregate, вы можете добавить более одной агрегации для каждого преобразования. |

| Союз | Используйте это преобразование для подключения двух или нескольких узлов и добавления событий с общими полями (с одинаковым именем и типом данных) в одну таблицу. Поля, которые не соответствуют, удаляются и не включаются в выходные данные. |

| Расширять | Используйте это преобразование для создания новой строки для каждого значения в массиве. |

| Присоединиться | Используйте это преобразование для объединения данных из двух потоков на основе соответствующего условия между ними. |

Помимо преобразований без кода, потоки событий поддерживают оператор SQL (предварительная версия) для обработки потока в коде. Используйте оператор SQL для определения пользовательской логики преобразования с помощью SQL-выражений, включая оконные функции, соединения и агрегации. Вы можете выбрать между преобразованиями без кода и разработкой на основе SQL в потоке событий для создания сложной логики потоковой передачи.

Если вы включили расширенные возможности при создании потока событий, операции преобразования поддерживаются для всех назначений. Производный поток служит промежуточным звеном для некоторых мест назначения, таких как пользовательская конечная точка и активатор Fabric. Если вы не включите расширенные возможности, операции преобразования доступны только для назначений lakehouse и eventhouse (обработка событий перед приемом).

Маршрутизация событий в места назначения

Функция потоков событий Fabric поддерживает отправку данных в следующие поддерживаемые назначения.

| Назначение | Описание |

|---|---|

| Пользовательская конечная точка (пользовательское приложение в стандартных функциях) | Используйте этот пункт назначения для направления событий в режиме реального времени на пользовательскую конечную точку. Вы можете подключить собственные приложения к потоку событий и использовать данные событий в режиме реального времени. Это назначение полезно, если вы хотите отправлять данные в режиме реального времени в систему за пределами Microsoft Fabric. |

| Eventhouse | Это назначение позволяет получать данные событий в реальном времени в хранилище событий, где можно использовать мощный язык запросов Kusto (KQL) для запроса и анализа данных. С помощью данных в хранилище событий вы можете получить более подробную информацию о данных о событиях и создать богатые отчеты и панели мониторинга. Вы можете выбрать между двумя режимами приема: прямой прием и обработка событий перед приемом. |

| Озёрный Дом | Это место назначения предоставляет вам возможность преобразовывать ваши события в режиме реального времени, прежде чем принимать их в озеро данных. События в режиме реального времени преобразуются в формат Delta Lake, а затем хранятся в указанных таблицах Lakehouse. Этот объект поддерживает сценарии хранения данных. |

| Записная книжка Spark (предварительная версия) | Добавьте назначение Записной книжки Spark для загрузки уже существующей записной книжки в рабочей области для обработки событий в потоках по умолчанию или производных потоках с использованием задания структурированной потоковой передачи Spark. Эта функция сейчас доступна в предварительной версии. |

| Производный поток | Этот специализированный тип назначения можно создать после добавления операций потока, таких как фильтр или управление полями, в поток событий. Производный поток представляет преобразованный поток по умолчанию после обработки потока. Вы можете перенаправить производный поток в несколько назначений в Fabric и просмотреть производный поток в концентраторе реального времени. |

| Activator | Вы можете использовать это место назначения для прямого подключения данных событий в реальном времени к Fabric Activator. Активатор — это тип интеллектуального агента, который содержит всю информацию, необходимую для подключения к данным, мониторинга условий и действий. Когда данные достигают определенных пороговых значений или совпадают с другими шаблонами, активатор автоматически принимает соответствующее действие, например оповещение пользователей или запуск рабочих процессов Power Automate. |

Вы можете подключить несколько пунктов назначения к потокам событий, чтобы одновременно получать данные из потоков событий, не мешая друг другу.

Управление схемами

Потоки событий предоставляют возможности управления схемами для управления и проверки структуры потоковых данных:

- Реестр схем (предварительная версия): централизованно регистрируйте и версии схемы с помощью реестра схем Fabric для управления эволюцией схемы в потоках событий. Дополнительные сведения см. в разделе "Использование схем событий в потоках событий".

- Выведение нескольких схем (предварительная версия): работа с несколькими схемами в рамках одного потока событий. Создайте разнообразные пути преобразования, выбрав соответствующую схему вывода для каждого пути. Дополнительные сведения см. в статье "Улучшение обработки событий с помощью нескольких выводов схемы".

- Десериализация на основе Confluent Schema Registry (предварительная версия): при приеме данных из Confluent Cloud для Apache Kafka потоки событий могут использовать реестр схем Confluent для десериализации сообщений, закодированных схемой, улучшая взаимодействие с экосистемами потоковой передачи на основе Confluent.

Эти функции улучшают управление схемами и интероперабельность при использовании различных потоков данных в ваших потоках событий.

DeltaFlow: потоки CDC, готовые к аналитике (предварительная версия)

DeltaFlow — это возможность в потоках событий Fabric, которая преобразует необработанные события отслеживания измененных данных (CDC) из операционных баз данных в данные потоковой передачи, готовые к аналитике.

Ключевые возможности DeltaFlow:

- Фигура событий, готовая к аналитике: события CDC преобразуются в табличный формат, который отражает структуру исходной таблицы. Затем вы можете создавать простые аналитические запросы с помощью таких средств, как язык запросов Kusto (KQL) без первого анализа вложенных полезных данных JSON Debezium.

- Автоматическая регистрация схемы: схемы исходных таблиц автоматически обнаруживаются в DeltaFlow и регистрируются в реестре схем Fabric.

- Автоматическое управление таблицами назначения. При маршрутизации потоков с поддержкой DeltaFlow в поддерживаемое назначение, например в хранилище событий, целевые таблицы автоматически создаются и управляются для сопоставления схемы исходной таблицы.

- Обработка эволюции схемы: при изменении исходных таблиц базы данных (например, добавляются новые столбцы или создаются новые таблицы), DeltaFlow автоматически обнаруживает изменения, обновляет зарегистрированные схемы и корректирует целевые таблицы соответствующим образом.

DeltaFlow (предварительная версия) доступен со следующими коннекторами источника CDC:

- SQL Azure базы данных CDC

- Управляемый экземпляр Azure SQL CDC

- SQL Server на виртуальной машине CDC

- База данных PostgreSQL CDC

Чтобы использовать DeltaFlow, выберите события, готовые для аналитики, и автоматически обновляемую схему на этапе обработки схемы при настройке соединителя CDC в качестве источника событийного потока. Сведения о том, как DeltaFlow преобразует необработанные события CDC в готовые к аналитике выходные данные, см. в разделе "Преобразование выходных данных DeltaFlow".

Примечание.

Рекомендуем использовать функцию потоков событий Fabric с не менее чем четырьмя единицами емкости : F4.

Apache Kafka в потоках событий Fabric

Функция потоков событий Fabric предлагает конечную точку Apache Kafka, чтобы подключить и использовать потоковые события через протокол Kafka. Если приложение уже использует протокол Apache Kafka для отправки или получения потоковых событий с определенными разделами, его можно легко подключить к потоку событий. Просто обновите параметры подключения, чтобы использовать конечную точку Kafka, указанную в потоке событий.

Функция потоков событий Fabric связана с Центрами событий Azure, полностью управляемой облачной службой. При создании потока событий пространство имен концентратора событий автоматически создается для вас. Концентратор событий назначается стандартному потоку без необходимости в каких-либо параметрах предоставления. Дополнительные сведения о функциях, совместимых с Kafka в Центрах событий Azure, см. в статье "Что такое Центры событий Azure для Apache Kafka?".

Дополнительные сведения о том, как получить сведения о конечной точке Kafka для отправки событий в поток событий, см. в статье "Добавление пользовательской конечной точки или пользовательского источника приложения в поток событий". Сведения об использовании событий из потока событий см. в разделе "Добавление настраиваемой конечной точки или назначения пользовательского приложения" в поток событий.

Функциональные возможности и возможности безопасности

Потоки событий предоставляют элементы управления для операционного управления и безопасного подключения:

- Приостановка и возобновление элементов управления: производные потоки событий поддерживают элементы управления приостановкой и возобновлением, чтобы можно было временно остановить обработку, не влияя на другие входные или выходные данные в потоке событий, а затем возобновить позже. Дополнительные сведения см. в статье "Приостановка и возобновление потоков данных".

- Приватная ссылка рабочей области (предварительная версия): выбранные источники и пункты назначения поддерживают Приватную ссылку рабочей области для приватного сетевого доступа, что помогает защитить входящие подключения к потокам событий. Дополнительные сведения см. в разделе "Безопасные входящие подключения" с использованием приватных ссылок для клиента и рабочей области.

Ограничения

Потоки событий Fabric имеют следующие общие ограничения. Прежде чем работать с потоками событий, ознакомьтесь с этими ограничениями, чтобы убедиться, что они соответствуют вашим требованиям.

| Лимит | Ценность |

|---|---|

| Максимальный размер сообщения | 1 МБ |

| Максимальный срок хранения данных о событиях | 90 дней |

| Гарантии надёжности доставки событий | По крайней мере один раз |