Примечание.

Для доступа к этой странице требуется авторизация. Вы можете попробовать войти или изменить каталоги.

Для доступа к этой странице требуется авторизация. Вы можете попробовать изменить каталоги.

В настоящее время просмотр:Версия портала Foundry (классическая версия) - Переключиться на версию для нового портала Foundry

Чтобы тщательно оценить производительность создаваемых моделей ИИ и приложений в значительном наборе данных, инициируйте процесс оценки. Во время этой оценки модель или приложение тестируются с заданным набором данных, а его производительность измеряется с помощью математических метрик и метрик с поддержкой ИИ. Этот тест предоставляет подробную информацию о возможностях и ограничениях приложения.

Используйте функции оценки на портале Microsoft Foundry, платформу, которая предлагает средства и функции для оценки производительности и безопасности моделей генерирования ИИ. На портале Foundry регистрируйте, просматривайте и анализируйте подробные метрики оценки.

В этой статье объясняется, как создать выполнение оценки для модели, агента или тестового набора данных с помощью встроенных метрик оценки из пользовательского интерфейса Foundry. Для повышения гибкости можно установить пользовательский поток оценки и использовать пользовательскую функцию оценки. Используйте пользовательскую функцию оценки для выполнения пакетного выполнения без оценки.

Необходимые условия

- Тестовый набор данных в одном из этих форматов: CSV или JSON Lines (JSONL).

- Подключение Azure OpenAI с развертыванием одной из этих моделей: модель GPT-3.5, модель GPT-4 или модель Davinci. Это необходимо только для оценки качества с помощью ИИ.

Создание оценки со встроенными метриками оценки

Выполнение оценки позволяет создавать выходные данные метрик для каждой строки данных в тестовом наборе данных. Выберите одну или несколько метрик оценки, чтобы оценить выходные данные из различных аспектов. Вы можете создать запуск процедуры оценки на страницах каталога оценки или модели в портале Foundry. Мастер создания оценки поможет вам настроить запуск оценки.

На странице оценки

В левой области выберите "Создать>оценку".

На странице каталога моделей

В левой области выберите каталог моделей.

Перейдите к модели.

Перейдите на вкладку "Тесты".

Выберите "Попробовать с собственными данными". Этот выбор открывает панель оценки модели, где можно создать запуск оценки для выбранной модели.

Целевой объект оценки

При запуске оценки на странице "Оценка " выберите целевой объект оценки. Указание соответствующего целевого объекта оценки настраивает оценку для конкретной природы приложения, обеспечивая точные и соответствующие метрики. Мы поддерживаем два типа целевых показателей оценки:

- Модель. Этот выбор оценивает выходные данные, созданные выбранной моделью и определяемым пользователем запросом.

- Набор данных: выходные данные, созданные моделью, уже находятся в тестовом наборе данных.

Настройка тестовых данных

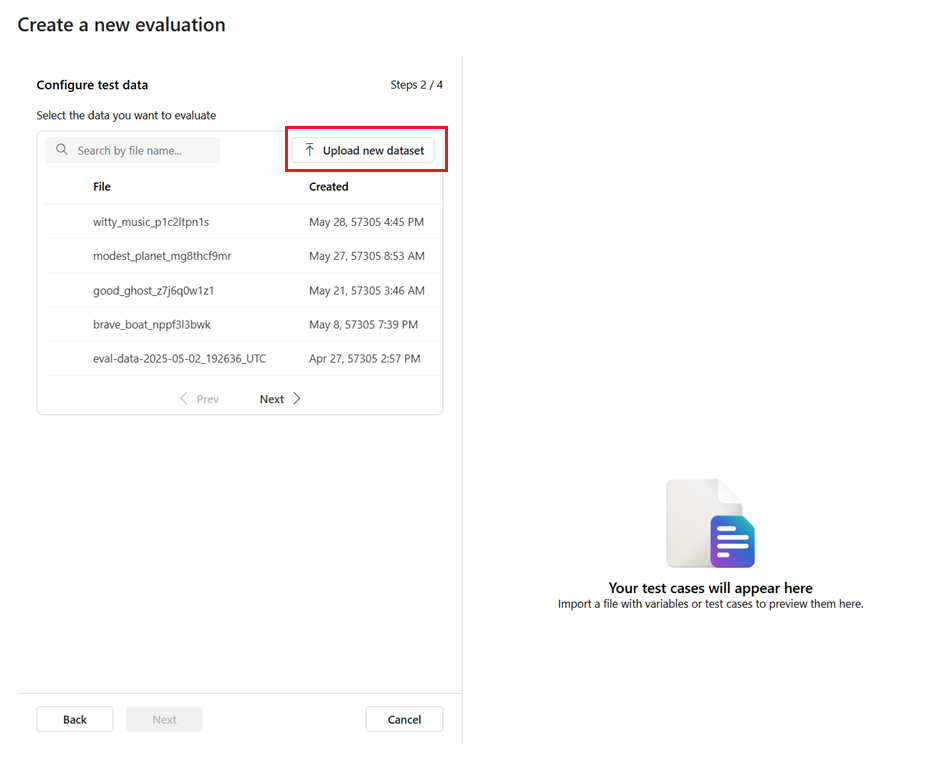

В мастере создания оценки выберите из предварительно созданных наборов данных или отправьте новый набор данных для оценки. Тестовый набор данных должен иметь созданные моделью выходные данные, которые будут использоваться для оценки. Предварительный просмотр тестовых данных отображается на правой панели.

Выберите существующий набор данных: можно выбрать тестовый набор данных из установленной коллекции наборов данных.

Добавьте новый набор данных: отправьте файлы из локального хранилища. Поддерживаются только форматы ФАЙЛОВ CSV и JSONL. Предварительный просмотр тестовых данных отображается на правой панели.

Настройка условий тестирования

Мы поддерживаем три типа метрик, которые курируются Microsoft для упрощения комплексной оценки приложения:

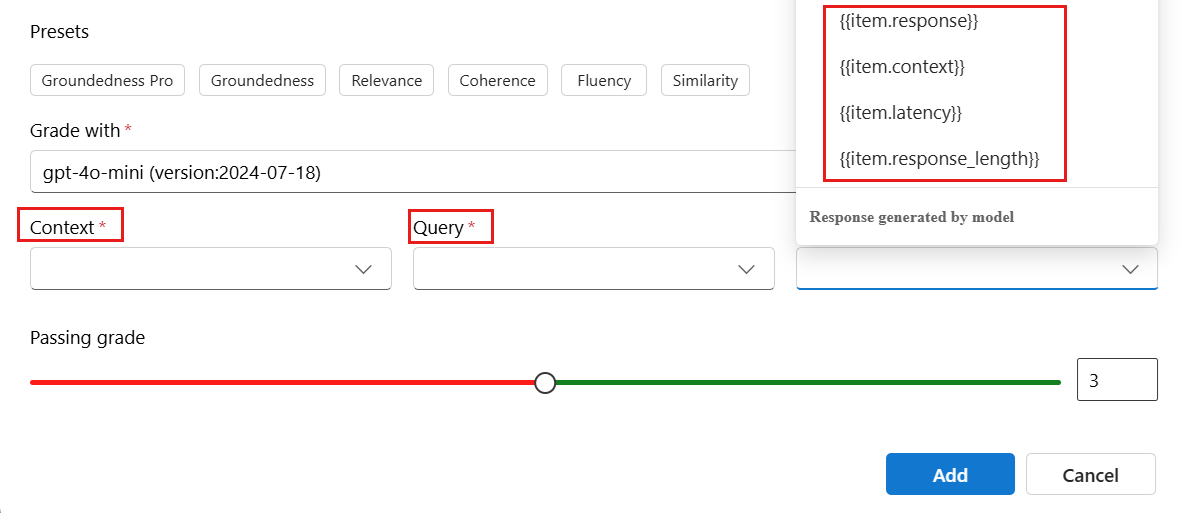

- Качество ИИ (СИ) — эти метрики оценивают общее качество и согласованность созданного содержимого. Чтобы запускать эти метрики, вам нужно развертывание модели, которое будет выступать в роли оценщика.

- Качество ИИ (NLP): эти метрики обработки естественного языка (NLP) являются математическими, и они также оценивают общее качество созданного содержимого. Для них часто требуются эталонные данные, но они не нуждаются в развертывании модели для оценки.

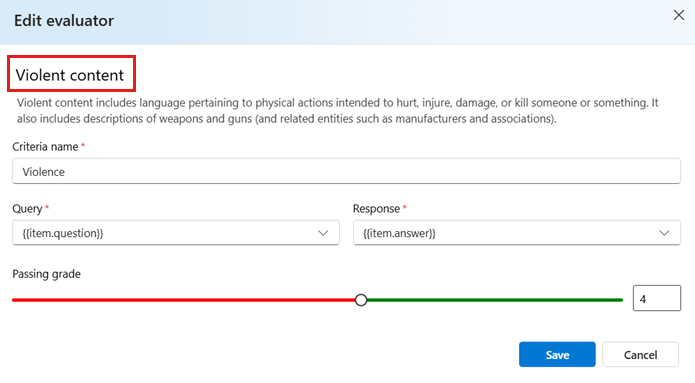

- Метрики риска и безопасности: эти метрики сосредоточены на выявлении потенциальных рисков содержимого и обеспечении безопасности созданного содержимого.

Вы также можете создать пользовательские метрики и выбрать их в качестве критериев оценки на этапе тестирования.

При добавлении критериев тестирования различные метрики будут использоваться в рамках оценки. Вы можете обратиться к таблице для полного списка метрик, для которых мы предлагаем поддержку в каждом сценарии. Дополнительные сведения о определениях метрик и их вычислении см. в статье "Встроенные оценщики".

| Качество ИИ (с поддержкой ИИ) | Качество ИИ (NLP) | Метрики риска и безопасности |

|---|---|---|

| Обоснованность, релевантность, согласованность, беглость, сходство с GPT | F1 score, ROUGE score, BLEU score, GLEU score, METEOR score | Содержимое, связанное с самоповреждением, ненавистный и несправедливый контент, насильственный контент, сексуальный контент, защищённый контент, косвенная атака |

При выполнении оценки качества с поддержкой ИИ необходимо указать модель GPT для процесса вычисления или оценки.

Метрики качества ИИ (NLP) — это математически основанные измерения, которые оценивают производительность приложения. Они часто требуют эталонных данных для вычисления. ROUGE — это семейство метрик. Для вычисления показателей можно выбрать тип ROUGE. Различные типы метрик ROUGE предлагают способы оценки качества создания текста. ROUGE-N измеряет перекрытие n-граммов между текстом-кандидатом и референсными текстами.

Для метрик риска и безопасности вам не нужно предоставлять развертывание. Портал Foundry предлагает модель GPT-4, которая может генерировать оценки серьезности рисков содержимого и обоснования, что позволяет вам оценивать ваше приложение на вредоносность содержимого.

Примечание

Метрики риска и безопасности с поддержкой искусственного интеллекта размещаются в оценках безопасности Foundry и доступны только в следующих регионах: Восточная часть США 2, Центральная Франция, Южная Великобритания, Центральная Швеция.

Осторожно

Пользователи, которые ранее управляли развертываниями моделей и выполняли оценки с помощью oai.azure.com, а затем подключены к платформе разработчика Microsoft Foundry, имеют следующие ограничения при использовании ai.azure.com:

- Эти пользователи не могут просматривать свои оценки, созданные с помощью AZURE API OpenAI. Чтобы просмотреть эти оценки, они должны вернуться в

oai.azure.com. - Эти пользователи не могут использовать AZURE API OpenAI для выполнения вычислений в Foundry. Вместо этого они должны продолжать использовать

oai.azure.comдля этой задачи. Однако они могут использовать оценщики Azure OpenAI, доступные непосредственно в Foundry (ai.azure.com) в параметре создания оценки набора данных. Параметр оценки модели с тонкой настройкой не поддерживается, если развертывание представляет собой миграцию из Azure OpenAI в Foundry.

Для сценария отправки набора данных и использования собственного хранилища существует несколько требований к конфигурации:

- Проверка подлинности учетной записи должна осуществляться через Microsoft Entra ID.

- Хранилище должно быть добавлено в учетную запись. Добавление его в проект приводит к ошибкам службы.

- Пользователи должны добавить свой проект в свою учетную запись хранения с помощью управления доступом на портале Azure.

Дополнительные сведения о создании оценок с помощью оценочных градеров OpenAI в Azure OpenAI хабе см. в статье Как использовать Azure OpenAI для оценки моделей в Foundry.

Сопоставление данных

Сопоставление данных для оценки. Для каждой добавленной метрики необходимо указать, какие столбцы данных в наборе данных соответствуют входным данным, необходимым в оценке. Различные метрики оценки требуют различных типов входных данных для точных вычислений.

Во время оценки ответ модели оценивается по ключевым входным данным, таким как:

- Запрос: обязательный для всех метрик.

- Контекст: необязательно.

- Исходные данные: необязательно, требуется для метрик качества ИИ (NLP).

Эти сопоставления обеспечивают точное выравнивание данных и критериев оценки.

Проверка и отправка

После завершения необходимых конфигураций укажите необязательное имя для оценки. Просмотрите параметры и нажмите кнопку "Отправить ", чтобы начать выполнение оценки.

Оценка модели

Чтобы создать новую оценку для выбранного развертывания модели, можно использовать модель GPT для создания примеров вопросов или выбрать из установленной коллекции наборов данных.

Настройка тестовых данных для модели

Настройте тестовый набор данных, используемый для оценки. Этот набор данных отправляется в модель для создания ответов для оценки. У вас есть два варианта настройки тестовых данных:

- Создание примера вопросов

- Использование существующего набора данных (или отправка нового набора данных)

Создание примера вопросов

Если у вас нет набора данных, который легко доступен и требуется выполнить оценку с небольшим примером, выберите развертывание модели, которую вы хотите оценить на основе выбранного раздела. Azure поддерживаются модели OpenAI и другие открытые модели, совместимые с бессерверным развертыванием API, например модели семейства Meta Llama и Phi-3.

Этот раздел настраивает созданное содержимое в интересующую вас область. Запросы и ответы создаются в режиме реального времени, и их можно повторно создать по мере необходимости.

Используйте свой набор данных

Вы также можете выбрать из установленной коллекции наборов данных или отправить новый набор данных.

Выбор метрик оценки

Чтобы настроить критерии тестирования, нажмите кнопку "Далее". При выборе условий добавляются метрики и необходимо сопоставить столбцы набора данных с необходимыми полями для оценки. Эти сопоставления обеспечивают точное выравнивание данных и критериев оценки.

Выбрав нужные критерии теста, можно просмотреть оценку, при необходимости изменить имя оценки, а затем нажмите кнопку "Отправить". Перейдите на страницу оценки, чтобы просмотреть результаты.

Примечание

Созданный набор данных сохраняется в хранилище блобов проекта после запуска оценки.

Просмотр и управление оценщиками в библиотеке оценщиков

Ознакомьтесь с деталями и состоянием ваших оценщиков в одном месте в библиотеке оценщиков. Просмотр и управление утвержденными Microsoft оценщиками.

Библиотека оценщика также поддерживает управление версиями. При необходимости можно сравнить различные версии работы, восстановить предыдущие версии и упростить совместную работу с другими пользователями.

Чтобы использовать библиотеку вычислителя на портале Foundry, перейдите на страницу оценки вашего проекта и выберите вкладку библиотеки вычислителя.

Выберите имя вычислителя, чтобы просмотреть дополнительные сведения, включая имя, описание, параметры и все связанные файлы. Ниже приведены некоторые примеры оценщиков, курируемых Microsoft:

- Для оценки производительности и качества, осуществляемой под эгидой Microsoft, ознакомьтесь с подсказкой для аннотаций на странице сведений. Адаптируйте эти запросы к вашему варианту использования. Измените параметры или критерии на основе данных и целей в пакете SDK для оценки Azure ИИ. Например, можно выбрать Groundedness-Evaluator и проверить файл Prompty, который показывает, как мы рассчитываем метрику.

- Сведения об оценках рисков и безопасности, которые курируются Microsoft, см. в определении метрик. Например, выберите Self-Harm-Related-Content-Evaluator, чтобы узнать, что это означает, и понять, как Microsoft определяет уровни серьезности.

Связанное содержимое

Дополнительные сведения об оценке создаваемых приложений ИИ: