Примечание.

Для доступа к этой странице требуется авторизация. Вы можете попробовать войти или изменить каталоги.

Для доступа к этой странице требуется авторизация. Вы можете попробовать изменить каталоги.

Применяется только к:Портал Foundry (классический). Эта статья недоступна для нового портала Foundry.

Дополнительные сведения о новом портале.

Примечание

Содержание в новой документации Microsoft Foundry может открываться по ссылкам в этой статье вместо документации Foundry (классической версии), которую вы просматриваете сейчас.

Если у вас уже есть проект ИИ в Microsoft Foundry, каталог моделей развертывает модели из поставщиков партнерских моделей в качестве автономных конечных точек в проекте по умолчанию. Каждое развертывание модели имеет собственный набор URI и учетных данных для доступа к нему. С другой стороны, модели Azure OpenAI развертываются в ресурсе Foundry или в ресурсе Azure OpenAI в Foundry Models.

Важно

Azure бета SDK для вывода ИИ устарел и будет прекращён 26 августа 2026 года. Перейдите на общедоступный API OpenAI/v1 с стабильным пакетом SDK OpenAI. Следуйте инструкциям по миграции , чтобы перейти на OpenAI/v1, используя пакет SDK для предпочитаемого языка программирования.

Это поведение можно изменить и развернуть оба типа моделей в ресурсах Foundry. После настройки развертывание моделей в качестве бессерверных развертываний API происходит с подключенным ресурсом Foundry вместо самого проекта, предоставляя вам один набор конечных точек и учетных данных для доступа ко всем моделям, развернутым в Foundry. Вы можете управлять моделями из Azure OpenAI и у поставщиков партнерских моделей таким же образом.

Кроме того, развертывание моделей в Foundry Models обеспечивает дополнительные преимущества:

- Возможность маршрутизации

- Пользовательские фильтры содержимого

- Глобальный тип развертывания возможностей

- Аутентификация без ключа с Microsoft Entra ID

Из этой статьи вы узнаете, как настроить проект для использования развертываний Foundry Models.

Необходимые условия

Чтобы завершить работу с этим руководством, вам потребуется:

Подписка Azure. Если вы используете модели GitHub, вы можете обновить интерфейс и создать подписку Azure в процессе. Дополнительные сведения см. в разделе Обновление из моделей GitHub в модели Foundry.

Ресурс Foundry. Дополнительные сведения см. в статье "Создание первого ресурса Foundry".

Проект и центр Foundry. Дополнительные сведения см. в статье "Создание и управление центром Foundry".

Совет

Когда центр искусственного интеллекта развернут, вместе с ним создается ресурс Foundry, и два ресурса подключаются. Чтобы увидеть, какой ресурс подключен к вашему проекту, перейдите в портал Foundry>, затем в центр управления>подключёнными ресурсами и найдите подключения типа Foundry Tools.

Настройка проекта для использования моделей Foundry

Чтобы настроить проект для использования возможности Foundry Models в Foundry, выполните следующие действия.

На целевой странице проекта выберите центр управления в нижней части бокового меню. Определите ресурс Foundry, подключенный к проекту.

Если ресурс не указан, в вашем AI Hub нет подключенного ресурса Foundry. Создайте новое подключение.

Выберите +Создать подключение, а затем выберите Microsoft Foundry на плитках.

В окне найдите существующий ресурс в подписке и выберите "Добавить подключение".

Новое подключение добавлено в ваш центр.

Вернитесь на целевую страницу проекта.

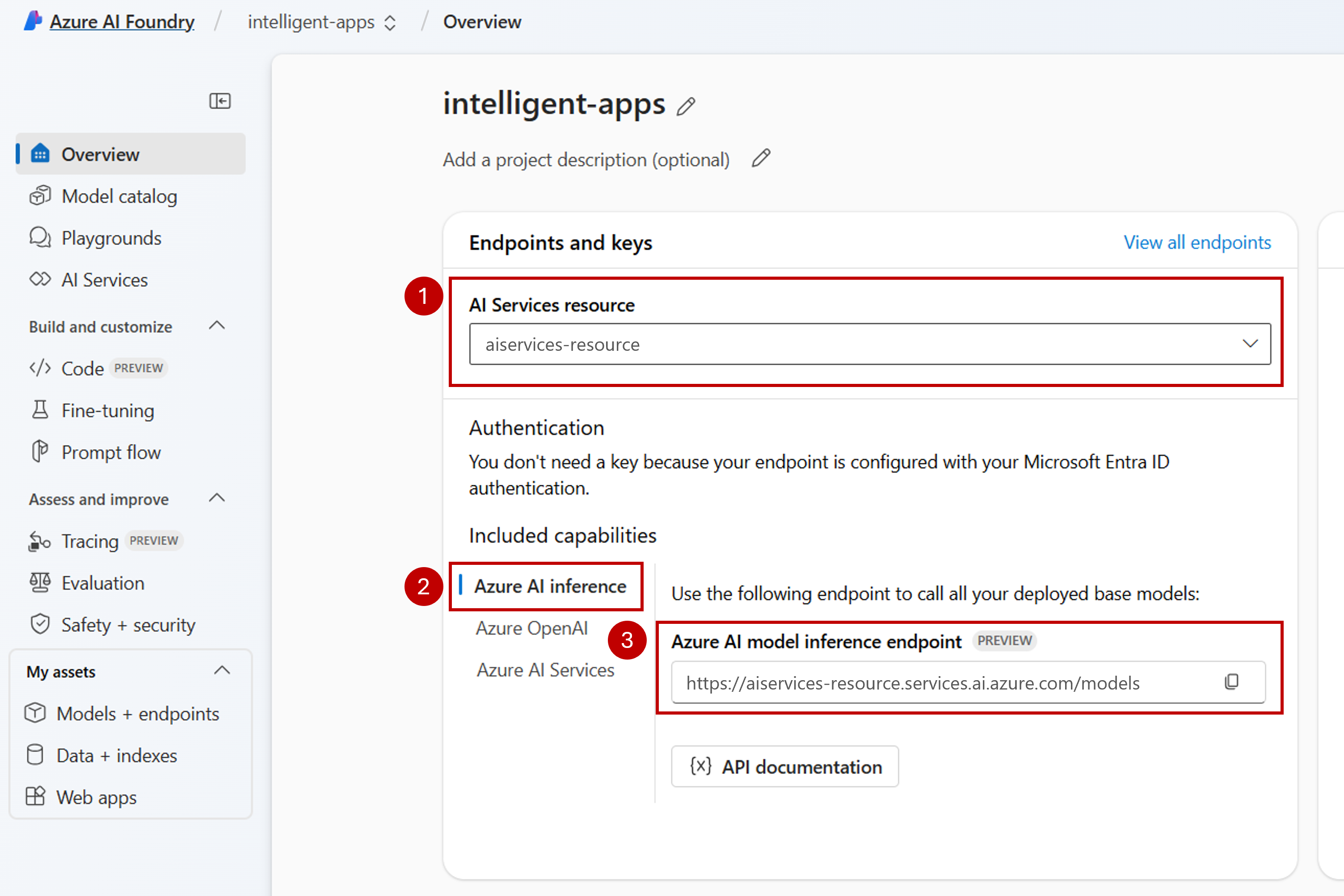

В разделе Включенные возможности убедитесь, что выбран Azure Вывод ИИ. URI конечной точки вывода модели ИИ Azure отображается вместе с учётными данными для доступа к ней.

Совет

Каждый ресурс Foundry имеет единую конечную точку вывода модели ИИ Azure, которую можно использовать для доступа к любому развертыванию модели на данном ресурсе. Одна конечная точка обслуживает несколько моделей в зависимости от того, какие из них настроены. Чтобы узнать, как работает конечная точка, см. конечную точку инференса Azure OpenAI.

Запишите URL-адрес конечной точки и учетные данные.

Создайте развертывание модели в Foundry Models

Для каждой модели, которую вы хотите развернуть в разделе "Модели Foundry", выполните следующие действия.

Перейдите в каталог моделей на портале Foundry.

Прокрутите страницу до нужной модели и выберите ее.

Вы можете просмотреть сведения о модели в карточке модели.

Выберите "Использовать эту модель".

Для поставщиков моделей, требующих дополнительных условий контракта, вам будет предложено принять эти условия, выбрав "Согласиться" и продолжить.

Вы можете настроить параметры развертывания в настоящее время. По умолчанию развертыванию присваивается имя модели, которую вы развертываете. Имя развертывания используется в параметре

modelчтобы запрос мог направляться именно к этому развертыванию модели. Он позволяет настраивать определенные имена для моделей при присоединении определенных конфигураций. Например,o1-preview-safeдля модели с строгим фильтром содержимого.Мы автоматически выбираем подключение Foundry в зависимости от проекта, так как вы включили функцию Deploy для Azure службы вывода моделей ИИ. Выберите "Настроить", чтобы изменить подключение в зависимости от ваших потребностей. Если вы развертываете в типе развертывания API без сервера , модели должны быть доступны в регионе ресурса Foundry.

Выберите Развернуть.

После завершения развертывания вы увидите URL-адрес конечной точки и учетные данные, чтобы получить доступ к модели. Обратите внимание, что теперь указанный URL-адрес и учетные данные совпадают с целевой страницей проекта для конечной точки Foundry Models.

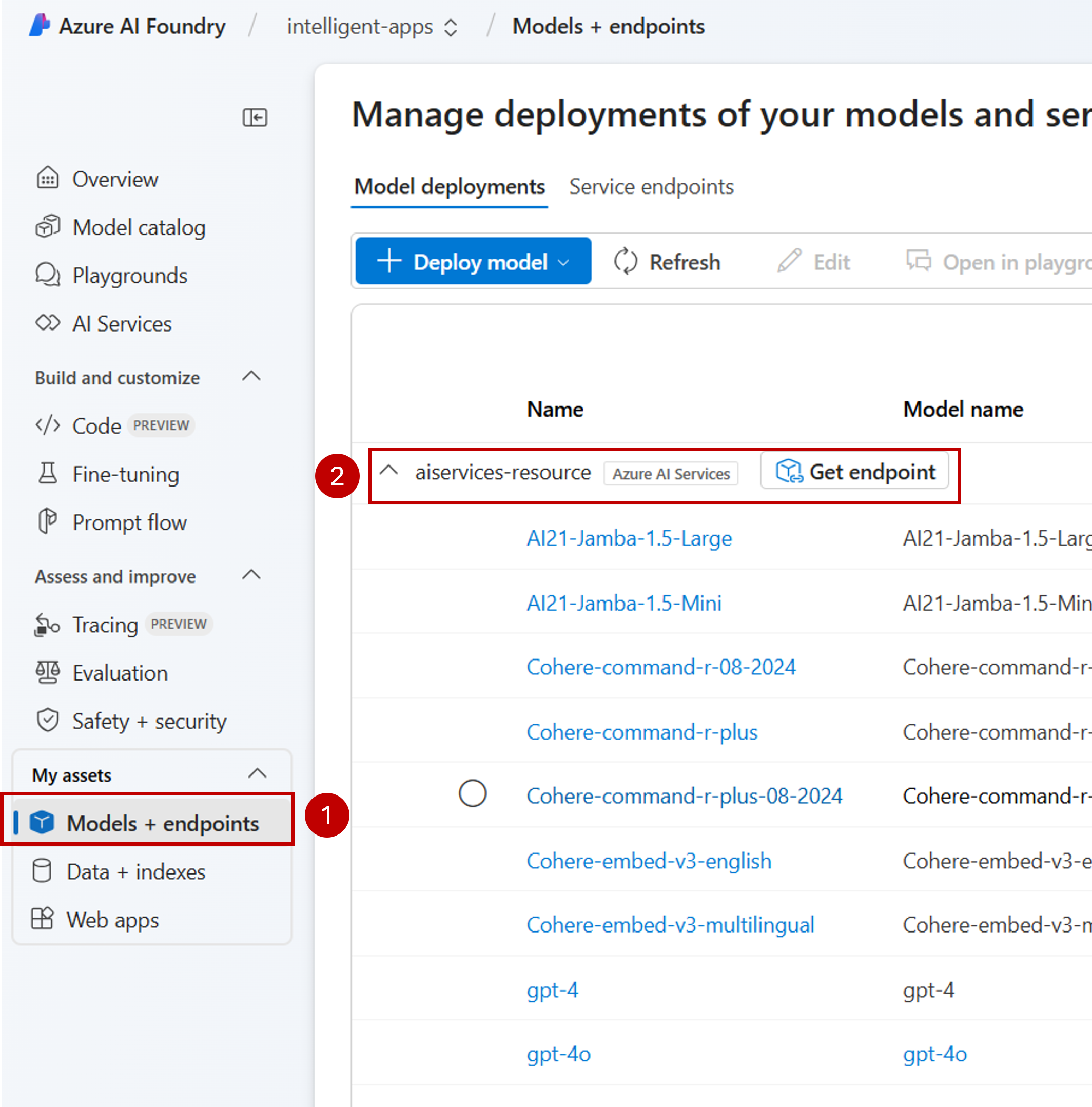

Чтобы просмотреть все модели, доступные в ресурсе, перейдите в раздел "Модели + конечные точки " и найдите группу для подключения к ресурсу:

Обновление кода с помощью новой конечной точки

После настройки ресурса Foundry, его можно начать использовать в коде. Вам нужен URL-адрес конечной точки и ключ для него, который можно найти в разделе "Обзор ".

Вы можете использовать любой из поддерживаемых пакетов SDK для получения прогнозов из конечной точки. Следующие пакеты SDK официально поддерживаются:

- OpenAI SDK

- пакет SDK Azure OpenAI

- пакет инференции ИИ Azure

- пакет проектов Azure ИИ

Дополнительные сведения и примеры см. в разделе Поддерживаемые языки программирования пакета SDK вывода Azure AI. В следующем примере показано, как использовать пакет вывода ИИ Azure с недавно развернутой моделью:

Установите пакет azure-ai-inference с помощью диспетчера пакетов, например pip:

pip install azure-ai-inference

Затем можно использовать пакет для использования модели. В следующем примере показано, как создать клиент для получения завершений чата:

import os

from azure.ai.inference import ChatCompletionsClient

from azure.core.credentials import AzureKeyCredential

client = ChatCompletionsClient(

endpoint="https://<resource>.services.ai.azure.com/models",

credential=AzureKeyCredential(os.environ["AZURE_INFERENCE_CREDENTIAL"]),

)

Ознакомьтесь с нашими образцами и прочитайте документацию API, чтобы начать работу.

Создайте первое завершение чата:

from azure.ai.inference.models import SystemMessage, UserMessage

response = client.complete(

messages=[

SystemMessage(content="You are a helpful assistant."),

UserMessage(content="Explain Riemann's conjecture in 1 paragraph"),

],

model="mistral-large"

)

print(response.choices[0].message.content)

Используйте параметр model="<deployment-name> для маршрутизации запроса в это развертывание.

Развертывания работают как псевдоним заданной модели в определенных конфигурациях. Сведения о том, как модели Foundry маршрутизируют развертывания, см. в статье «Маршрутизация».

Переход из бессерверных развертываний API в модели Foundry

Хотя проект настроен для использования моделей Foundry, существующие развертывания моделей продолжают существовать в проекте в качестве бессерверных развертываний API. Эти развертывания не перемещаются для вас. Таким образом, можно постепенно обновить существующий код, ссылающийся на предыдущие развертывания модели. Чтобы приступить к перемещению развертываний модели, рекомендуется выполнить следующий рабочий процесс:

Повторно создайте развертывание модели в Foundry Models. Это развертывание модели доступно в точке доступа Foundry Models.

Обновите код, чтобы использовать новую конечную точку.

Очистите проект, удалив развертывание бессерверного API.

Обновление кода с помощью новой конечной точки

После развертывания моделей в разделе Foundry можно обновить код, чтобы использовать конечную точку Foundry Models. Основное различие между развертыванием бессерверных API и моделью Foundry Model находится в URL-адресе конечной точки и параметре модели. Хотя в развертываниях API без сервера есть набор URI и ключ для каждого развертывания модели, Модели Foundry имеют только один для всех из них.

В следующей таблице перечислены внесенные изменения.

| Свойство | Развертывания бессерверных API | Литейные модели |

|---|---|---|

| Конечная точка | https://<endpoint-name>.<region>.inference.ai.azure.com |

https://<ai-resource>.services.ai.azure.com/models |

| Учетные данные | Один на модель или конечную точку. | Один на ресурс Foundry. Вы также можете использовать Microsoft Entra ID. |

| Параметр модели | Ни один. | Обязательно. Используйте имя развертывания модели. |

Очистка существующих развертываний бессерверных API из проекта

После рефакторинга кода может потребоваться удалить существующие бессерверные развертывания API внутри проекта (если таковые есть).

Для каждой модели, развернутой в качестве бессерверных развертываний API, выполните следующие действия.

Перейдите на портал Foundry.

Выберите модели и конечные точки, а затем перейдите на вкладку "Конечные точки службы ".

Определите конечные точки развертывания API типа бессерверный и выберите ту, которую хотите удалить.

Выберите параметр Delete.

Предупреждение

Эту операцию нельзя отменить. Убедитесь, что конечная точка в настоящее время не используется любым другим пользователем или фрагментом кода.

Подтвердите операцию, нажав кнопку "Удалить".

Если вы создали подключение API бессерверного развертывания к этой конечной точке из других проектов, такие подключения не удаляются и продолжают указывать на несуществующую конечную точку. Удалите любое из этих подключений для предотвращения ошибок.

Ограничения

При настройке проекта для использования моделей Foundry следует учитывать следующие ограничения.

- Доступны только модели, поддерживающие бессерверные развертывания API для развертывания в модели Foundry. Модели, требующие квоты вычислений из подписки (управляемые вычисления), включая пользовательские модели, могут быть развернуты только в рамках данного проекта как управляемые онлайн-конечные точки и остаются доступными с помощью собственного набора URI конечной точки и учетных данных.

- Модели, доступные как развертывания бессерверных API и управляемые вычислительные предложения, по умолчанию развертываются в модели Foundry в рамках ресурсов Foundry. Портал Foundry не предлагает способ развертывания их в управляемых онлайн-конечных точках. Для выполнения развертывания необходимо отключить функцию, упомянутую в Настройка проекта для использования моделей Foundry или использовать Azure CLI/Azure ML SDK/шаблоны ARM.