Примечание

Для доступа к этой странице требуется авторизация. Вы можете попробовать войти или изменить каталоги.

Для доступа к этой странице требуется авторизация. Вы можете попробовать изменить каталоги.

Это важно

Элементы, обозначенные в этой статье как (предварительная версия), сейчас предлагаются в общедоступной предварительной версии. Эта предварительная версия предоставляется без соглашения об уровне обслуживания, и мы не рекомендуем ее для рабочих нагрузок. Некоторые функции могут не поддерживаться или их возможности могут быть ограничены. Для получения дополнительной информации см. Дополнительные условия использования для предварительных версий Microsoft Azure.

Каталог моделей на портале Azure AI Foundry — это центр для обнаружения и использования широкого спектра моделей для создания создаваемых приложений ИИ. Каталог моделей включает сотни моделей в таких поставщиках моделей, как Azure OpenAI Service, Mistral, Meta, Cohere, NVIDIA и Hugging Face, включая модели, обученные Корпорацией Майкрософт. Модели от поставщиков, отличных от корпорации Майкрософт, являются продуктами, не являющихся корпорацией Майкрософт, как определено в условиях продуктов Майкрософт, и применяются к условиям, предоставленным моделями.

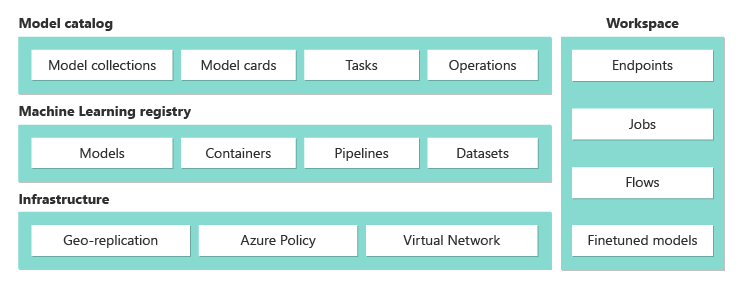

Коллекции моделей

Каталог моделей упорядочивает модели в разные коллекции:

Самые популярные партнерские модели курируются ИИ Azure: открытые и собственные модели упакованы и оптимизированы для эффективной работы на платформе ИИ Azure. Использование этих моделей подчиняется условиям лицензионного соглашения поставщиков моделей. При развертывании этих моделей на портале Azure AI Foundry их доступность определяется действующим соглашением об уровне обслуживания Azure (SLA), а корпорация Майкрософт предоставляет поддержку в случае возникновения проблем с развертыванием.

Модели от партнеров, таких как Meta, NVIDIA и Mistral AI, являются примерами моделей, доступных в этой коллекции в каталоге. Эти модели можно определить, если искать зеленую галочку на плитках с моделями в каталоге. Вы также можете отфильтровать данные по коллекции, отобранной ИИ Azure.

Модели Azure OpenAI доступны исключительно в Azure: флагманские модели Azure OpenAI, доступные через интеграцию со службой Azure OpenAI. Корпорация Майкрософт поддерживает эти модели и их использование в соответствии с условиями продукта и соглашением об уровне обслуживания для Azure OpenAI Service.

Откройте модели из хаба Hugging Face: сотни моделей из хаба Hugging Face для инференции в реальном времени с управляемыми вычислениями. Hugging Face создает и поддерживает модели, перечисленные в этой коллекции. Для получения помощи воспользуйтесь форумом Hugging Face или обращайтесь в поддержку Hugging Face. Дополнительные сведения см. в разделе "Развертывание открытых моделей с помощью Azure AI Foundry".

Вы можете отправить запрос на добавление модели в каталог моделей с помощью этой формы.

Общие сведения о возможностях каталога моделей

Вы можете искать и находить модели, которые соответствуют вашим требованиям через keyword search и filters. Каталог моделей также предлагает метрики производительности для избранных моделей. Вы можете получить доступ к эталону, щелкнув Compare Models или через вкладку «Эталонные тесты» на карточке модели.

На карточке модели вы найдете:

- Краткие факты: вы увидите ключевые сведения о модели на быстром взгляде.

- Сведения: эта страница содержит подробные сведения о модели, включая описание, сведения о версии, поддерживаемый тип данных и т. д.

- Тесты: вы найдете метрики теста производительности для выбора моделей.

- Существующие развертывания: если вы уже развернули модель, ее можно найти на вкладке "Существующие развертывания".

- Примеры кода: вы найдете основные примеры кода для начала разработки приложений ИИ.

- Лицензия: вы найдете юридическую информацию, связанную с лицензированием модели.

- Артефакты: эта вкладка будет отображаться только для открытых моделей. Вы можете просмотреть ресурсы модели и скачать их через пользовательский интерфейс.

Развертывание модели: Azure OpenAI

Дополнительные сведения о моделях Azure OpenAI см. в статье "Что такое Служба Azure OpenAI?".

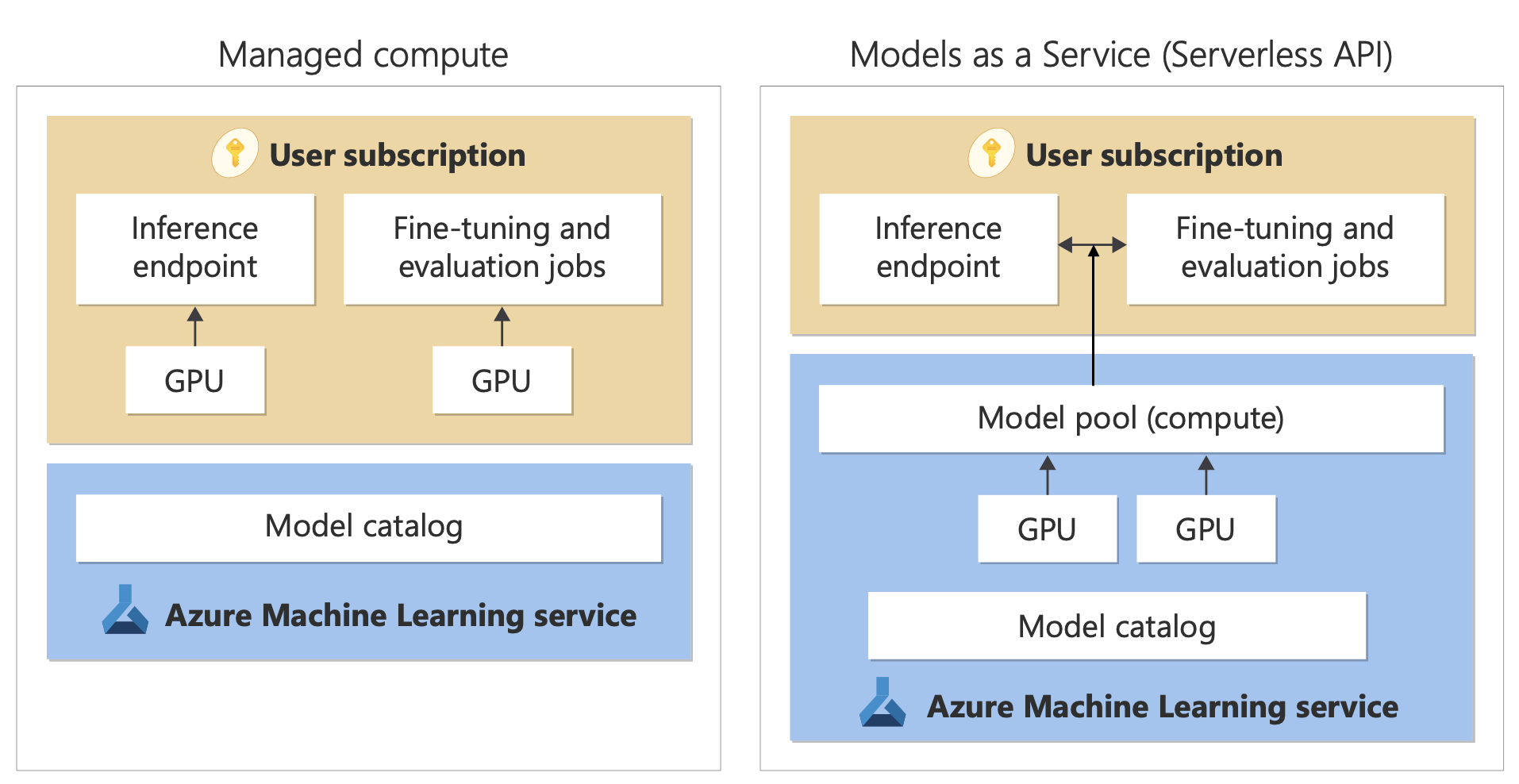

Развертывание модели: управляемые вычислительные и бессерверные API

Помимо моделей службы Azure OpenAI, каталог моделей предлагает два различных способа развертывания моделей для использования: управляемые вычислительные и бессерверные API.

Варианты развертывания и функции, доступные для каждой модели, зависят, как описано в следующих таблицах. Узнайте больше об обработке данных с параметрами развертывания.

Возможности параметров развертывания модели

| Функции | Управляемые вычисления | Бессерверный API (оплата за токен) |

|---|---|---|

| Опыт развертывания и выставления счетов | Веса модели развертываются на выделенных виртуальных машинах с управляемыми вычислениями. Управляемый вычислительный ресурс, который может иметь одно или несколько развертываний, предоставляет REST API для выполнения выводов. С вас взимается плата за часы работы ядер виртуальных машин, которые используются развертываниями. | Доступ к моделям осуществляется через развертывание, которое подготавливает API для доступа к модели. API предоставляет доступ к модели, размещённой и управляемой Microsoft для выполнения операций вывода. Плата за входные и выходные данные в API обычно взимается в токенах. Сведения о ценах предоставляются перед развертыванием. |

| Проверка подлинности API | Ключи и проверка подлинности Microsoft Entra. | Только ключи. |

| Безопасность содержимого | Используйте API службы безопасности содержимого Azure. | Фильтры безопасности содержимого Azure AI доступны в интеграции с API инференции. Фильтры безопасности содержимого Azure оплачиваются отдельно. |

| Сетевая изоляция | Настройте управляемые сети для узлов Azure AI Foundry. | Управляемые вычисления следуют параметру флага доступа к общедоступной сети (PNA) концентратора. Дополнительные сведения см. в разделе " Сетевая изоляция для моделей, развернутых с помощью бессерверных API" далее в этой статье. |

Доступные модели для поддерживаемых вариантов развертывания

Модели Azure OpenAI см. в разделе "Модели службы Azure OpenAI".

Чтобы просмотреть список поддерживаемых моделей для бессерверных API или управляемых вычислений, перейдите на домашнюю страницу каталога моделей в Azure AI Foundry. Используйте фильтр параметров развертывания , чтобы выбрать бессерверный API или управляемые вычисления.

Жизненный цикл модели: устаревание и прекращение использования

Модели ИИ развиваются быстро, и когда новая версия или новая модель с обновленными возможностями в том же семействе моделей становятся доступными, старые модели могут быть сняты в каталоге моделей AI Foundry. Чтобы обеспечить плавное переход на более новую версию модели, некоторые модели предоставляют пользователям возможность включить автоматическое обновление. Дополнительные сведения о жизненном цикле различных моделей, предстоящих датах прекращения использования моделей и предлагаемых заменах моделей и версий см.:

- Запланированное устаревание и вывод из эксплуатации моделей Azure OpenAI Service

- Устаревания и снятие с эксплуатации модели API без сервера

Управляемые вычисления

Возможность развертывания моделей в качестве управляемых вычислительных ресурсов основана на возможностях платформы Машинное обучение Azure для обеспечения простой интеграции широкой коллекции моделей в каталоге моделей во всем жизненном цикле операций с крупной языковой моделью (LLM).

Доступность моделей для развертывания как управляемых вычислительных сервисов

Модели становятся доступными через реестры Azure Machine Learning. Эти реестры позволяют использовать подход с приоритетом на машинное обучение для размещения и распределения ресурсов Azure Machine Learning. К этим ресурсам относятся весы моделей, среды выполнения контейнеров для выполнения моделей, конвейеры для оценки и точной настройки моделей, а также наборы данных для тестов и примеров.

Реестры создаются на основе высокомасштабируемой и корпоративной инфраструктуры, которая:

Предоставляет артефакты модели доступа с минимальной задержкой во всех регионах Azure благодаря встроенной георепликации.

Поддерживает требования корпоративной безопасности, такие как ограничение доступа к моделям с помощью Политика Azure и безопасного развертывания с помощью управляемых виртуальных сетей.

Развертывание моделей для вывода с помощью управляемых вычислений

Модели, доступные для развертывания для управляемых вычислений, можно развернуть для Машинное обучение Azure управляемых вычислений для вывода в режиме реального времени. При развертывании на управляемых вычислительных ресурсах требуется иметь квоту виртуальных машин в подписке Azure для конкретных продуктов, необходимых для оптимальной работы модели. Некоторые модели позволяют развертывать временно общую квоту для тестирования моделей.

Дополнительные сведения о развертывании моделей:

Создание генеративных ИИ приложений с помощью управляемых вычислительных ресурсов

Функция потока запросов в Машинное обучение Azure предлагает отличный интерфейс для создания прототипов. Модели, развернутые с управляемыми вычислительными ресурсами, можно использовать в потоке подсказок с помощью средства Open Model LLM. Вы также можете использовать REST API, предоставляемый управляемыми вычислениями, в популярных инструментах LLM, таких как LangChain с расширением Машинное обучение Azure.

Безопасность содержимого для моделей, развернутых как управляемые вычислительные ресурсы

Служба безопасности содержимого Azure AI доступна для использования в среде с управляемыми вычислительными ресурсами для проверки различных категорий неуместного содержимого, таких как сексуальное содержимое, насилие, ненависть и нанесение себе вреда. Вы также можете использовать службу для анализа дополнительных угроз, таких как обнаружение рисков джейлбрейка и обнаружение защищенного текста материала.

Эту записную книжку можно использовать в качестве справочного материала об интеграции со службой безопасности содержимого Azure AI для Llama 2. Кроме того, вы можете использовать средство "Безопасность содержимого (текст)" в потоках запросов для передачи ответов от модели в систему безопасности контента Azure ИИ для проверки. Плата взимается отдельно за использование, как описано в ценах на безопасность содержимого ИИ Azure.

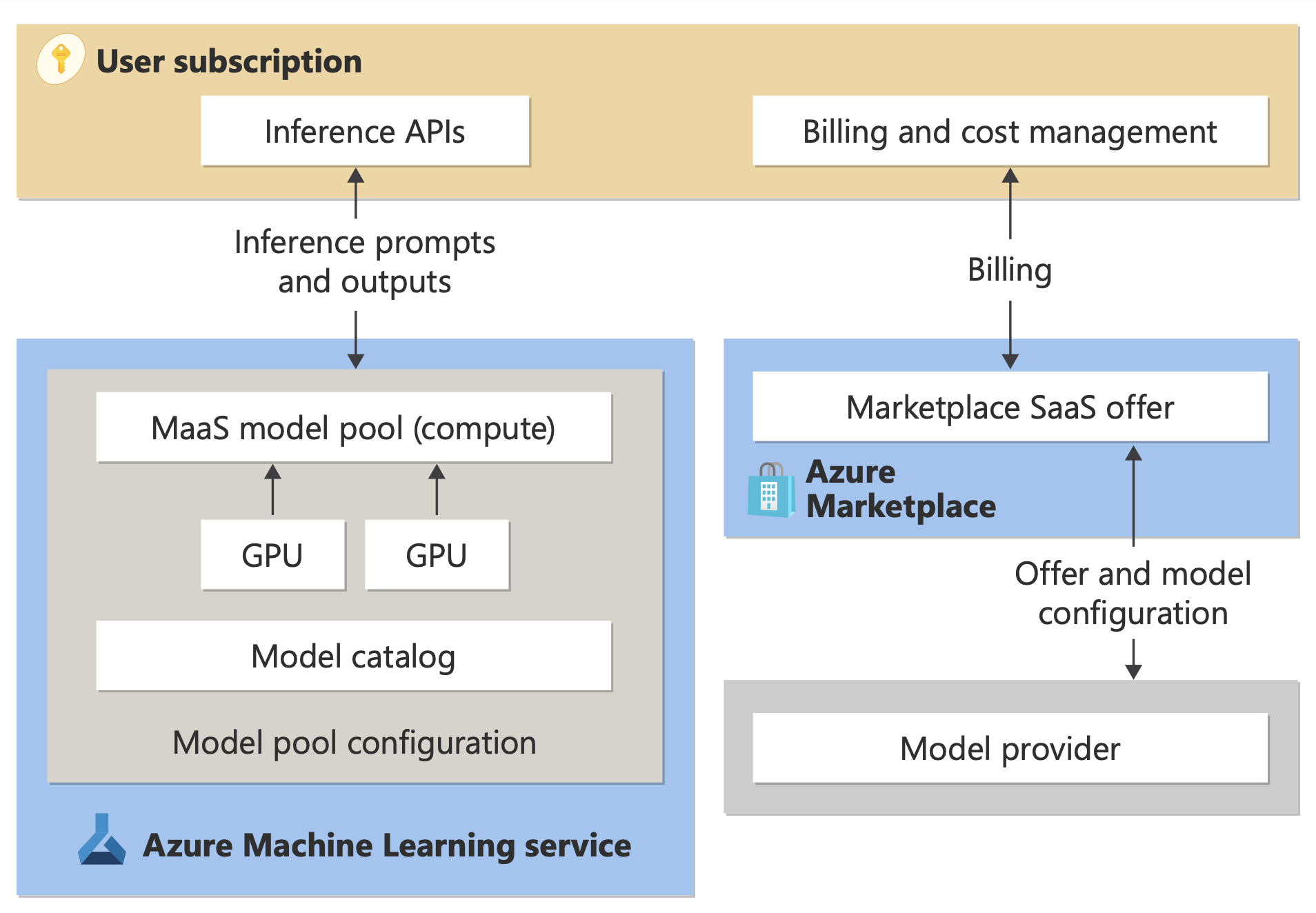

Оплата бессерверного API (по принципу оплаты за токен)

Вы можете развернуть определенные модели в каталоге моделей с оплатой за количество токенов. Этот метод развертывания, также называемый БЕССерверным API, предоставляет способ использования моделей в качестве API без размещения их в подписке. Модели размещаются в управляемой корпорацией Майкрософт инфраструктуре, которая обеспечивает доступ на основе API к модели поставщика моделей. Доступ на основе API может значительно сократить затраты на доступ к модели и упростить процесс подготовки.

Модели, доступные для развертывания в качестве бессерверных API с выставлением счетов по мере использования, предлагаются поставщиком моделей, но они размещаются в инфраструктуре, управляемой Корпорацией Майкрософт, и доступ к ним осуществляется через API. Поставщики моделей определяют условия лицензии и устанавливают цену на использование своих моделей. Служба Машинное обучение Azure:

- Управляет инфраструктурой размещения.

- Делает API вывода результатов доступными.

- Выступает в качестве обработчика данных для запросов и результатов обработки содержимого, которые обрабатываются моделями, развернутыми с помощью MaaS.

Дополнительные сведения об обработке данных для MaaS см. в статье о конфиденциальности данных.

Замечание

Подписки поставщиков облачных решений (CSP) не имеют возможности приобрести модели бессерверных развертываний API (MaaS).

Выставление счетов

Опыт обнаружения, подписки и потребления моделей, развернутых с помощью MaaS, представлен в портале Azure AI Foundry и студии машинного обучения Azure. Пользователи принимают условия лицензии для использования моделей. Сведения о ценах на потребление предоставляются во время развертывания.

Счета за модели от поставщиков, отличных от Майкрософт, выставляются через Azure Marketplace в соответствии с условиями использования Коммерческой платформы Майкрософт.

Счета за модели от Microsoft выставляются через счетчики Azure как сервисы потребления первой стороны. Как описано в условиях продукта, вы приобретаете службы потребления первой стороны с помощью счетчиков Azure, но они не применяются к условиям службы Azure. Использование этих моделей подпадает под указанные лицензионные условия.

Тонкая настройка моделей

Некоторые модели также поддерживают точную настройку. Для этих моделей можно воспользоваться преимуществами управляемых вычислений (предварительная версия) или бессерверной настройки API для настройки моделей с помощью предоставленных данных. Дополнительные сведения см. в обзоре тонкой настройки.

RAG с моделями, развернутыми как бессерверные API

На портале Azure AI Foundry можно использовать векторные индексы и расширенное поколение (RAG). Вы можете использовать модели, которые можно развернуть с помощью бессерверных API для создания внедрения и вывода на основе пользовательских данных. Эти внедрения и вывод могут затем создавать ответы, относящиеся к вашему варианту использования. Дополнительные сведения см. в статье "Создание и использование векторных индексов" на портале Azure AI Foundry.

Региональная доступность предложений и моделей

Выставление счетов за токен доступно только пользователям, подписка Azure которой принадлежит учетной записи выставления счетов в стране или регионе, где поставщик модели сделал предложение доступным. Если предложение доступно в соответствующем регионе, пользователь должен иметь ресурс проекта в регионе Azure, где модель доступна для развертывания или тонкой настройки, как применимо. См. Доступность регионов для моделей в конечных точках API с функцией без сервера | Azure AI Foundry для получения подробной информации.

Безопасность содержимого для моделей, развернутых с помощью бессерверных API

Для языковых моделей, развернутых с помощью бессерверных API, Azure AI реализует конфигурацию по умолчанию фильтров модерации текста безопасности содержимого ИИ Azure, которые обнаруживают вредное содержимое, например ненависть, самоповредение, сексуальное и насильственное содержимое. Дополнительные сведения о фильтрации содержимого (предварительная версия) см. в статье "Безопасность содержимого для моделей, управляемых ИИ Azure" в каталоге моделей.

Подсказка

Фильтрация содержимого (предварительная версия) недоступна для определенных типов моделей, развернутых через бессерверные API. Эти типы моделей включают модели встраивания и модели временных рядов.

Фильтрация содержимого (предварительная версия) выполняется синхронно в то время, как служба обрабатывает запросы для создания содержимого. Вам могут выставить счет отдельно в соответствии с ценами на безопасность содержимого Azure AI для такого использования. Вы можете отключить фильтрацию содержимого (предварительная версия) для отдельных бессерверных конечных точек:

- Во время первого развертывания языковой модели

- Позже, выбрав переключатель фильтрации содержимого на странице сведений о развертывании

Предположим, вы решите использовать API, отличный от API вывода модели ИИ Azure, для работы с моделью, развернутой через бессерверный API. В такой ситуации фильтрация содержимого (предварительная версия) не включена, если только вы не реализуете его отдельно с помощью безопасности содержимого ИИ Azure.

Чтобы начать работу с безопасностью контента Azure AI, см. краткое руководство: Анализ текстового контента. Если при работе с моделями, развернутыми через бессерверные API, не используется фильтрация содержимого (предварительная версия), то при работе с моделями, развернутыми через бессерверные API, возникает более высокий риск предоставления пользователям вредного содержимого.

Сетевая изоляция для моделей, развернутых с помощью бессерверных API

Конечные точки моделей, развернутых в виде бессерверных API, следуют установке флага доступа к публичной сети концентратора Azure AI Foundry в проекте, где развертывание осуществляется. Чтобы защитить конечную точку API без сервера, отключите флаг доступа к общедоступной сети в центре Azure AI Foundry. Вы можете защитить входящий трафик от клиента к конечной точке с помощью частной конечной точки для концентратора.

Чтобы задать флаг доступа к общедоступной сети для центра Azure AI Foundry, выполните следующие действия.

- Перейдите на портал Azure.

- Найдите группу ресурсов, к которой принадлежит концентратор, и выберите центр Azure AI Foundry из ресурсов, перечисленных для этой группы ресурсов.

- На странице обзора концентратора на левой панели перейдите в раздел "Параметры>сети".

- На вкладке "Общедоступный доступ" можно настроить параметры для флага доступа к общедоступной сети.

- Сохраните ваши изменения. Для распространения изменений может потребоваться до пяти минут.

Ограничения

Если у вас есть центр Azure AI Foundry с частной конечной точкой, созданной до 11 июля 2024 г., конечные точки API без сервера, добавленные в проекты в этом концентраторе, не будут следовать конфигурации сети концентратора. Вместо этого необходимо создать частную конечную точку для концентратора и создать новые бессерверные развертывания API в проекте, чтобы новые развертывания могли следовать конфигурации сети концентратора.

Если у вас есть центр Azure AI Foundry с развертываниями MaaS, созданными до 11 июля 2024 года, и вы включите частную конечную точку в этом концентраторе, существующие бессерверные развертывания API не будут следовать конфигурации сети концентратора. Для того чтобы развертывания бессерверных API в концентраторе соответствовали конфигурации его сети, необходимо создать развертывания заново.

В настоящее время поддержка Azure OpenAI On Your Data недоступна для развертываний бессерверных API в частных центрах, так как частные центры имеют флаг доступа к общедоступной сети отключен.

Любое изменение конфигурации сети (например, включение или отключение флага доступа к общедоступной сети) может занять до пяти минут.