Примечание.

Для доступа к этой странице требуется авторизация. Вы можете попробовать войти или изменить каталоги.

Для доступа к этой странице требуется авторизация. Вы можете попробовать изменить каталоги.

Tip

Power BI Dataflow 1-го поколения теперь находится в устаревшем состоянии и не получит новых инвестиций в функции. Для премиум-клиентов с доступом к Fabric, Dataflow Gen2 является рекомендуемым решением, предлагая улучшения в производительности, масштабируемости, надежности, функциональности и встроенном ИИ. Клиенты Pro/PPU могут продолжать использовать Gen1, так как руководства по Gen2 для этих сценариев всё ещё разрабатываются. См. статью Обновление с Dataflow Gen1 до Dataflow Gen2 для получения инструкций по обновлению.

В этом руководстве показано, как использовать файл Excel и соединитель потоков данных в Power Automate для создания отчета мониторинга потоков данных в Power BI.

Сначала вы скачайте файл Excel и сохраните его в OneDrive для работы или учебного заведения или SharePoint. Затем вы создадите соединитель Power Automate, который загружает метаданные из потока данных в файл Excel в OneDrive для работы или учебного заведения или SharePoint. Наконец, вы подключаете файл Power BI к файлу Excel, чтобы визуализировать метаданные и начать мониторинг потоков данных.

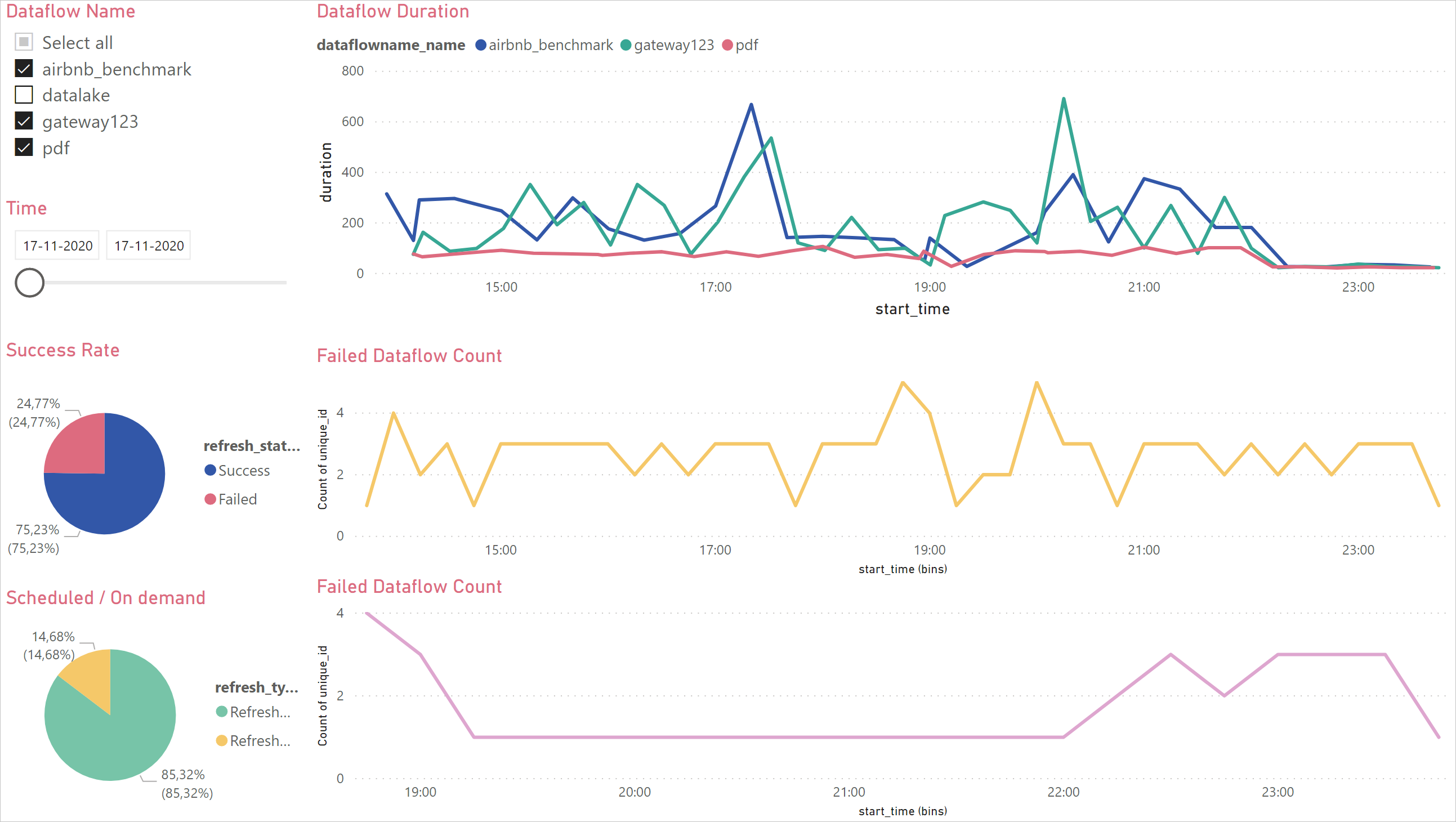

Эту панель мониторинга можно использовать для мониторинга длительности обновления и количества сбоев потоков данных. С помощью этой панели мониторинга вы можете отслеживать любые проблемы с производительностью потоков данных и предоставлять доступ к данным другим пользователям.

Предпосылки

Microsoft Excel

Скачайте .pbit файл

Сначала скачайте PBIT-файл.

Скачивание файла Excel и сохранение в OneDrive

Затем скачайте файл.xlsx и сохраните его в местоположение на OneDrive для работы или учебного заведения или SharePoint.

Создание потока данных

Если у вас еще нет, создайте поток данных. Поток данных можно создать в потоках данных Power BI или в потоках данных Power Apps.

Создание потока в Power Automate

Перейдите в Power Automate.

Выберите "Создать>автоматизированный облачный поток".

Введите название потока, затем найдите соединитель "По завершении обновления потока данных". Выберите этот соединитель из списка и нажмите кнопку "Создать".

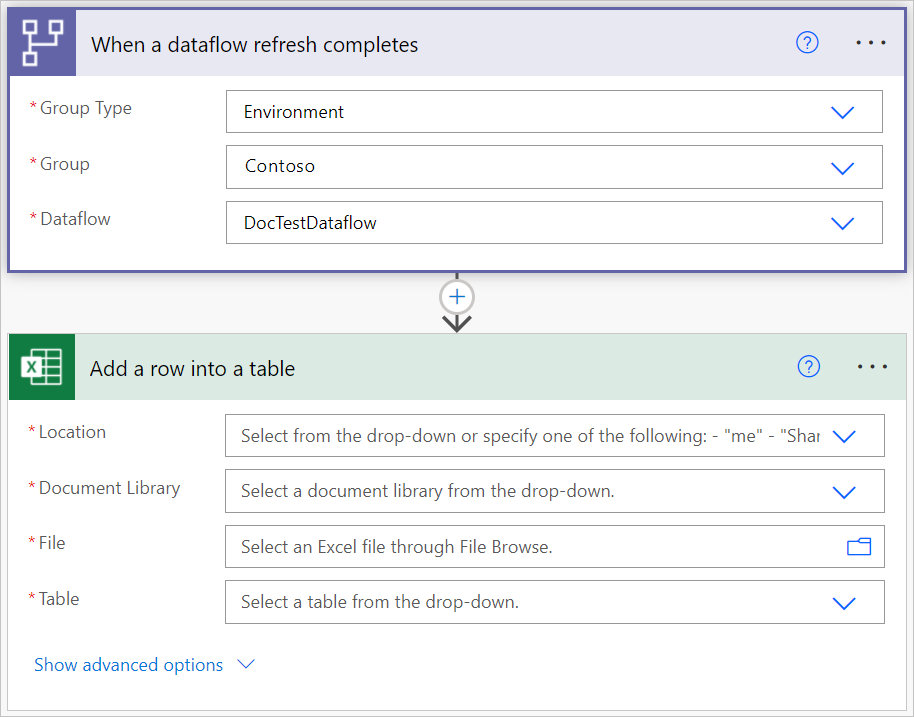

Настройка соединителя. Введите следующие сведения о потоке данных:

- Тип группы: выберите среду при подключении к Power Apps и рабочей области при подключении к Power BI.

- Группа. Выберите среду Power Apps или рабочую область Power BI, в которой находится поток данных.

- Поток данных: выберите поток данных по имени.

Выберите новый шаг , чтобы добавить действие в поток.

Найдите соединитель "Добавить строку в таблицу" из Excel Online (бизнес), а затем выберите его.

Настройка соединителя. Введите расположение файла Excel и конкретную таблицу , в которые загружаются данные.

- Расположение. Выберите расположение файла Excel в OneDrive для работы или учебного заведения или SharePoint.

- Библиотека документов: выберите библиотеку файла Excel.

- Файл. Выберите путь к файлу Excel.

- Таблица: выберите "Dataflow_monitoring".

Добавьте динамические значения в обязательные поля.

Для каждого обязательного поля необходимо добавить динамическое значение. Это значение представляет собой выходные данные метаданных запуска потока данных.

Сохраните поток.

Создание отчета Power BI

Откройте файл

.pbit.Подключитесь к файлу Excel.

На этой панели мониторинга для каждого потока данных в указанном интервале времени можно отслеживать:

- Длительность потока данных

- Число потоков данных

- Число сбоев потока данных

Слияние между именем потока данных и временем начала потока данных создает уникальный идентификатор для каждого потока данных.