Примечание.

Для доступа к этой странице требуется авторизация. Вы можете попробовать войти или изменить каталоги.

Для доступа к этой странице требуется авторизация. Вы можете попробовать изменить каталоги.

Расширение Visual Studio Code для обработки данных Fabric полностью поддерживает операции создания, чтения, обновления и удаления (CRUD) для определения заданий в Spark. После создания определения задания Spark можно отправить дополнительные ссылки на библиотеки, отправить запрос на выполнение определения задания Spark и проверить журнал выполнения.

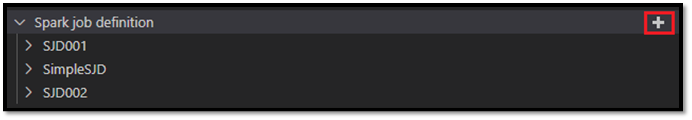

Создание определения задания Spark

Чтобы создать новое определение задания Spark, выполните приведенные далее действия.

В обозревателе VS Code выберите параметр "Создать определение задания Spark".

Введите начальные обязательные поля: имя, ссылка на lakehouse и lakehouse по умолчанию.

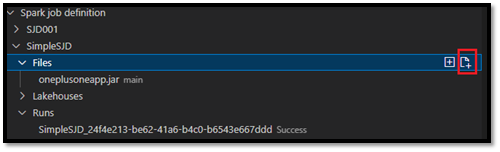

Процессы обработки запроса и имя вашего недавно созданного определения задания Spark отображаются в корневом узле определения задания Spark в эксплорере VS Code. В узле имени задания Spark вы увидите три поднода:

- Файлы: список основного файла определения и других ссылочных библиотек. Вы можете отправить новые файлы из этого списка.

-

Lakehouse: список всех Lakehouse, на которые ссылается это определение задания Spark. Озеро по умолчанию помечается в списке, и вы можете получить к нему доступ через относительный путь

Files/…, Tables/…. - Запуск: список истории выполнения этого определения задания Spark и статус задачи каждого запуска.

Отправка файла основного определения в ссылаемую библиотеку

Чтобы отправить или перезаписать файл основного определения, выберите параметр "Добавить основной файл ".

Чтобы отправить файл библиотеки, на который ссылается основной файл определения, выберите параметр "Добавить lib file ".

После отправки файла его можно переопределить, щелкнув параметр "Обновить файл" и отправив новый файл, или удалить его с помощью параметра "Удалить ".

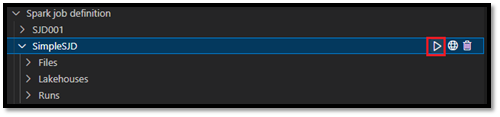

Отправка запроса на выполнение

Чтобы отправить запрос на выполнение определения задания Spark из VS Code:

В параметрах справа от имени определения задания Spark, которое вы хотите запустить, выберите параметр "Выполнить задание Spark".

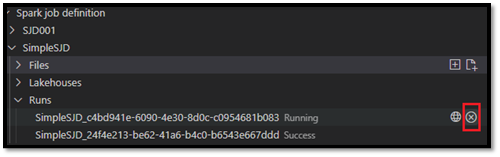

После отправки запроса новое приложение Apache Spark появится в узле "Запуски " в списке обозревателя. Вы можете отменить выполняемую работу, выбрав параметр "Отменить задание Spark".

Открытие определения задания Spark на портале Fabric

Вы можете открыть страницу разработки определения задания Spark на портале Fabric, выбрав параметр "Открыть в браузере ".

Вы также можете выбрать "Открыть в браузере " рядом с завершенным запуском, чтобы просмотреть страницу мониторинга сведений этого запуска.

Отладка исходного кода определения задания Spark (Python)

Если определение задания Spark создано с помощью PySpark (Python), можно скачать сценарий .py файла основного определения и файла, на который ссылается ссылка, и выполнить отладку исходного скрипта в VS Code.

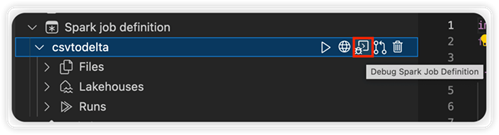

Чтобы скачать исходный код, выберите Определение задачи Spark для отладки, расположенное справа от определения задачи Spark.

После завершения скачивания папка исходного кода автоматически открывается.

При появлении запроса выберите параметр "Доверять авторам". (Этот параметр отображается только при первом открытии папки. Если этот параметр не выбран, вы не сможете выполнить отладку или запустить исходный скрипт. Дополнительные сведения см. в разделе "Безопасность доверия рабочей области Visual Studio Code".)

Если вы скачали исходный код раньше, вам будет предложено подтвердить, что вы хотите перезаписать локальную версию с новой загрузкой.

Примечание.

В корневой папке исходного скрипта система создает вложенную папку conf. В этой папке файл с именем lighter-config.json содержит некоторые системные метаданные, необходимые для удаленного запуска. Не вносите в него какие-либо изменения.

Файл с именем sparkconf.py содержит фрагмент кода, который необходимо добавить для настройки объекта SparkConf . Чтобы включить удаленную отладку, убедитесь, что объект SparkConf настроен правильно. На следующем рисунке показана исходная версия исходного кода.

Следующий образ — обновленный исходный код после копирования и вставки фрагмента кода.

После обновления исходного кода с необходимым conf необходимо выбрать правильный интерпретатор Python. Убедитесь, что вы выбрали установку из среды conda synapse-spark-kernel.

Изменение свойств определения задания Spark

Вы можете изменить подробные свойства определений заданий Spark, например аргументы командной строки.

Выберите параметр "Обновить конфигурацию SJD", чтобы открыть файл settings.yml. Существующие свойства заполняют содержимое этого файла.

Обновите и сохраните файл .yml.

Выберите параметр "Опубликовать свойство SJD" в правом верхнем углу, чтобы синхронизировать изменение обратно с удаленной рабочей областью.